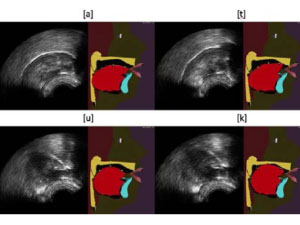

Une équipe de chercheurs du laboratoire Grenoble Images Parole Signal Automatique (GIPSA-lab : CNRS/Université Grenoble Alpes/Grenoble INP) et d’Inria Grenoble Rhône-Alpes vient de mettre au point un système permettant de visualiser, en temps réel, nos propres mouvements de langue. Capturés à l’aide d’une sonde échographique placée sous la mâchoire, ces mouvements sont traités par un algorithme d’apprentissage automatique qui permet de piloter une « tête parlante articulatoire ». En plus du visage et des lèvres, cet avatar fait apparaître la langue, le palais et les dents habituellement cachés à l’intérieur de l’appareil vocal. Ce système de « retour visuel », qui devrait permettre de mieux comprendre et donc de mieux corriger sa prononciation, pourra servir à la rééducation orthophonique ou l’apprentissage d’une langue étrangère. Ces travaux sont publiés dans la revue Speech Communication d’octobre 2017.

Vous trouverez le communiqué de presse dans son intégralité.

Image : © Thomas Hueber / GIPSA-Lab (CNRS/Université Grenoble Alpes / Grenoble INP)

Vous trouverez le communiqué de presse dans son intégralité.

Image : © Thomas Hueber / GIPSA-Lab (CNRS/Université Grenoble Alpes / Grenoble INP)

Contact

- Vice-présidente Recherche

Valérie Perrier

Tél. 04 56 52 86 41 - Vice-présidente Entreprises & Valorisation

Gaëlle Calvary

Tél. 06 31 77 86 71 - Directeur de la DRIVE

Cédric Di Tofano Orlando

Tél. 04 76 57 43 16 - Annuaire